Zagranica reguluje, Polska milczy. Jak wydawcy naukowi (nie) radzą sobie z AI

Generatywna sztuczna inteligencja (GenAI) weszła do warsztatu naukowego bez zaproszenia i bez regulaminu. Naukowcy piszą za jej pomocą wnioski grantowe i artykuły, tłumaczą teksty, przeglądają literaturę, analizują dane. Kto odpowiada za tekst, który w jednej trzeciej napisał duży model językowy? Kto bierze odpowiedzialność za recenzję sporządzoną za pomocą czatbota?

Czołowe wydawnictwa naukowe na świecie zaczęły odpowiadać na te pytania już kilka lat temu, a ich podejścia, choć różne, mają wspólną oś: transparentność, odpowiedzialność, ochrona poufności. W Polsce większość wydawców akademickich milczy. W poniższym artykule opisujemy, gdzie jest świat, a gdzie Polska, oraz co należy zrobić, żeby ten dystans przestał się zwiększać.

Nowe narzędzia, stare pytania

Generatywna sztuczna inteligencja i duże modele językowe (DMJ) nie są już nowinką technologiczną, którą można zbyć wzruszeniem ramion. Są codziennym narzędziem pracy naukowej – obecnym w procesach, które wcześniej w całości należały do człowieka. Badania przeprowadzone wśród ponad 200 naukowców z nauk medycznych pokazują, że 87,6% z nich zna potencjał DMJ. Wśród tych, którzy sięgają po GenAI regularnie, 64,9% używa jej do korekty językowej, a 57,2% do pisania i edycji tekstów naukowych. Liczby te dotyczą jednej, stosunkowo konserwatywnej dyscypliny. W naukach humanistycznych, informatycznych czy społecznych wyglądałyby prawdopodobnie jeszcze bardziej dobitnie.

Warto na chwilę zatrzymać się przy tym, co GenAI i DMJ realnie oferują nauce. Przegląd literatury, który zajmował tygodnie, można teraz przeprowadzić wstępnie w ciągu paru godzin: model przeskanuje setki abstraktów, wskaże luki tematyczne, zaproponuje kategorie. Dla polskiego naukowca, dla którego angielski jest językiem obcym, narzędzie korygujące gramatykę i styl może być czynnikiem decydującym o przyjęciu artykułu do zagranicznego czasopisma, a więc o widoczności jego badań w globalnym obiegu. Analiza danych jakościowych – wywiadów, dokumentów, otwartych odpowiedzi ankietowych – zyskuje nowy wymiar skalowania: tam, gdzie dawniej badacz kodował ręcznie setki stron, dziś może weryfikować wzorce na tysiącach. W procesie redakcyjnym GenAI pomaga optymalizować metadane, streszczenia i słowa kluczowe, co bezpośrednio przekłada się na indeksowanie w bazach bibliograficznych i cytowania. To nie są obietnice przyszłości. To praktyki, które część polskich badaczy stosuje już teraz – po cichu, bez żadnych wytycznych i bez możliwości uczenia się od siebie nawzajem.

Pytanie nie brzmi już, czy używać GenAI w nauce, lecz jak używać jej przejrzyście i odpowiedzialnie. I tu zaczynają się schody. Bo o ile kwestia techniczna – że model językowy potrafi wygenerować spójny akapit – jest jasna, o tyle kwestia etyczna, prawna i instytucjonalna pozostaje nieuregulowana lub regulowana niekonsekwentnie. Problem ten ma kilka warstw. Pierwsza dotyczy tekstu: kto jest autorem zdania, które człowiek zaproponował, a model przepisał? Druga dotyczy danych: czy wyniki analizy przeprowadzonej przy pomocy DMJ są reprodukowalne i wiarygodne? Trzecia, może najważniejsza, dotyczy recenzji: co dzieje się z niepublikowanymi wynikami badań, które recenzent – z dobrą wolą, szukając lepszego sformułowania – wkleił do czatbota? Te pytania nie są retoryczne. Mają realne skutki prawne, etyczne i reputacyjne dla całych instytucji.

Reakcja wydawców była szybka, ale niejednolita. Pierwsze instytucjonalne stanowiska wobec GenAI w publikowaniu naukowym pojawiły się już w pierwszej połowie 2023 roku – kilka miesięcy po publicznym debiucie ChatGPT. Organizacje, takie jak Committee on Publication Ethics (COPE), World Association of Medical Editors (WAME), European Association of Science Editors (EASE) oraz konsorcjum STM Publishers, opublikowały wytyczne lub rekomendacje. Zrobiły to też największe wydawnictwa: Elsevier, Springer Nature, Wiley. Pierwsze podejście było często kategoryczne – zakazy, ostrzeżenia, sztywne granice. Z dzisiejszej perspektywy widać, że część tych stanowisk została złagodzona i zniuansowana. Zakazy ustąpiły miejsca wymogom transparentności, kategoryczne „nie” zamieniło się w warunkowe „tak, ale”. Ewolucja trwa i będzie trwać, bo technologia nie czeka.

To nie jest akademicka abstrakcja ani fanaberia kilku zagranicznych wydawców. To realne, naglące wyzwanie, które polskie środowisko naukowe musi podjąć – i to nie za rok, lecz teraz.

Czego nikt nie kwestionuje

Zanim przejdziemy do obszarów spornych i niejasnych, warto ustalić fundament. Istnieje kilka zasad, co do których zgadzają się wszyscy poważni gracze w ekosystemie komunikacji naukowej; od organizacji branżowych po poszczególnych wydawców, od Nature i Cell po mniejsze niszowe oficyny.

Pierwsza zasada: GenAI nie może być autorem ani współautorem pracy naukowej. Dotyczy to każdego modelu językowego, narzędzia do generowania obrazów czy analizy danych. Autorstwo w nauce wiąże się z odpowiedzialnością prawną i etyczną, a odpowiedzialność tę można przypisać wyłącznie człowiekowi. Model językowy nie może odpowiedzieć przed żadną komisją ds. etyki badań, nie może wycofać artykułu, nie może zostać pociągnięty do odpowiedzialności za plagiat lub fabrykację danych.

Zasada druga wynika bezpośrednio z pierwszej: człowiek ponosi pełną odpowiedzialność za każdą część tekstu naukowego, włącznie z fragmentami, które zostały wygenerowane przez GenAI. Nie ma możliwości oddelegowania odpowiedzialności na narzędzie. Jeśli model językowy wygenerował akapit zawierający błędną informację lub nieistniejące odwołanie, a autor umieścił je w tekście bez weryfikacji, to odpowiada autor, nie model.

Zasada trzecia to transparentność. Ujawnienie zastosowania GenAI w procesie powstawania pracy jest obowiązkowe. Różni wydawcy inaczej definiują zakres tego ujawnienia (gdzie, jak szczegółowo, w jakiej formie), ale sam obowiązek deklaracji jest niemal powszechny.

Zasada czwarta dotyczy poufności: prac recenzowanych przez zewnętrznych recenzentów nie wolno przesyłać do zewnętrznych serwisów. Praca naukowa przed publikacją jest własnością intelektualną autorów i objęta jest obowiązkiem poufności ze strony wszystkich uczestników procesu wydawniczego. Zasilenie nim publicznego czatbota – nawet wyłącznie w celu korekty stylistycznej – to naruszenie tej poufności.

Warto podkreślić, że te cztery zasady nie są wynalazkiem ostatnich dwóch lat. Są adaptacją do nowych warunków technologicznych wartości, które etyka badań naukowych znała od dekad: rzetelności, odpowiedzialności, transparentności i ochrony informacji poufnych. GenAI nie zmieniła zasad – zmieniła kontekst, w którym należy je stosować. I właśnie dlatego tak łatwo wyprowadzić z nich konkretne polityki: wystarczy zapytać, jak te stare zasady odnoszą się do nowej sytuacji. To są cztery filary, na których powinna opierać się każda polityka GenAI w czasopiśmie naukowym. Nie są kontrowersyjne. Są punktem wyjścia, nie punktem dojścia.

Od zielonego światła do systemowego zakazu

Na tych czterech filarach różni wydawcy budują bardzo odmienne polityki. Spektrum jest szerokie i warto je zobaczyć poprzez konkrety.

Na liberalnym biegunie sytuuje się INFORMS, wydawca prestiżowych czasopism z zakresu badań operacyjnych. Organizacja ta nie wymaga od autorów deklarowania konkretnych narzędzi GenAI ani składania osobnych oświadczeń. Przyjmuje zasadę, że sam fakt przesłania manuskryptu jest równoznaczny z deklaracją, że autor zweryfikował wszelkie treści wygenerowane przez AI i bierze za nie pełną odpowiedzialność. Podejście to ma swoją logikę: skoro autorzy nie muszą deklarować użycia edytora tekstu czy wyszukiwarki bibliograficznej, dlaczego GenAI miałaby być wyjątkiem? Krytycy tego stanowiska odpowiadają jednak: edytor tekstu nie generuje treści, których autor mógłby nie poddać krytycznej weryfikacji.

Zbliżone, choć bardziej sformalizowane podejście przyjmuje MDPI – wydawca dużej liczby tytułów w modelu otwartym. Dopuszcza szerokie zastosowania GenAI, wymaga jednak pełnej transparentności przy tworzeniu merytorycznej warstwy pracy. Autorzy muszą zadeklarować użycie GenAI, jeśli pomagała ona w pisaniu tekstu, generowaniu grafik, projektowaniu badania czy analizie danych (szczegółowy opis musi znaleźć się w sekcji Materials and Methods). Jedynym wyjątkiem są prosta korekta językowa i formatowanie, które nie wymagają zgłoszenia. W przeciwieństwie do INFORMS, MDPI dopuszcza też ograniczone wsparcie AI dla recenzentów (np. w celu poprawy gramatyki recenzji), o ile zostanie to ujawnione.

Bardziej sformalizowane i rygorystyczne procedury wprowadza Elsevier – jeden z największych wydawców naukowych. Wymaga od autorów umieszczenia osobnej, dedykowanej sekcji „Use of AI and AI-assisted technologies in the writing process” bezpośrednio przed bibliografią. Wydawca ten idzie o krok dalej w restrykcjach: całkowicie zakazuje używania GenAI do tworzenia lub modyfikowania grafik i obrazów (chyba że AI jest samym przedmiotem badania). Jednocześnie Elsevier zajmuje bezkompromisowe stanowisko wobec recenzentów i redaktorów: stosowanie GenAI, nawet do poprawy stylu recenzji, jest surowo zabronione. Powód jest prosty – recenzja zawiera poufne dane manuskryptu, a wprowadzenie ich do systemów AI narusza fundamenty bezpieczeństwa własności intelektualnej.

Na restrykcyjnym biegunie stoi Emerald Publishing. Wydawca ten zakazuje generowania przez GenAI jakiejkolwiek merytorycznej części pracy, w tym nawet metadanych, takich jak abstrakty. Co więcej, jako jeden z nielicznych wymaga deklaracji użycia technologii generatywnych nawet w procesie korekty autorskiego tekstu (copy-editing), o ile użyte narzędzia mają charakter generatywny. Choć dopuszcza tworzenie prostych schematów czy grafik ilustracyjnych przy pomocy GenAI (czego zakazuje np. Elsevier), to w obszarze pracy z tekstem i przejrzystości procesu redakcyjnego wybiera maksymalną transparentność kosztem wygody autorów.

Wśród polskich wydawców widać podobną rozpiętość podejść, choć skala jest nieporównanie mniejsza. Wydawnictwo Uniwersytetu Łódzkiego wypracowało standard, który można by nazwać laboratoryjnym: autorzy są zobowiązani do podania nazwy narzędzia GenAI, jego wersji, czasu zapytania oraz pełnej treści promptu. To podejście radykalne i budzące pewne pytania, do których wrócimy – ale świadome i przemyślane. Politechnika Gdańska z kolei przyjęła zasadę bliską stanowisku Nature: zakaz przesyłania recenzowanych prac do zewnętrznych serwisów GenAI. Prosta, konkretna, możliwa do egzekwowania.

Wniosek z tego przeglądu jest taki: nie istnieje jedno słuszne podejście do GenAI w publikowaniu naukowym. W tym spektrum każda instytucja musi znaleźć swoje miejsce – świadomie, nie przez zaniechanie.

Polska – regulacyjna cisza

Dane są bezlitosne. Spośród wszystkich wydawców czasopism z zakresu bibliotekoznawstwa i informacji naukowej pierwszego decylu (Top 10%) rankingu Scopus, tylko jeden nie publikuje żadnych wytycznych. W Polsce sytuacja wygląda zgoła odwrotnie: spośród 20 wydawców akademickich z uczelni objętych programem „Inicjatywa Doskonałości – Uczelnia Badawcza” tylko 7 wypracowało jakiekolwiek wytyczne dotyczące GenAI. Pozostałych dwunastu milczy w tej kwestii zupełnie.

Ta cisza ma swoje konsekwencje. Autorzy są zdani na domysły: nie wiedzą, czy mogą poprawić angielską gramatykę swojego artykułu za pomocą narzędzia językowego, czy muszą to deklarować, a jeśli tak, to w jaki sposób. Jeden autor deklaruje wszystko, inny nic i obaj sądzą, że postępują właściwie, bo nikt im niczego nie zakomunikował. Również recenzenci robią to, co uważają za stosowne, nie wiedząc, czy „przeczytanie” manuskryptu czatbotowi narusza jakieś zobowiązania, a nawet jeśli wiedzą, że narusza, mogą uznać, że i tak nikt tego nie sprawdzi. Redaktorzy nie mają procedur ani narzędzi reagowania. I nikt nikomu niczego nie wyjaśnia, bo wymagałoby to wcześniejszego podjęcia decyzji, a ta wymagałaby refleksji, na którą brakuje czasu lub woli.

Konsekwencją jest także kwestia wiarygodności i szansy, której być może nie będzie się już dało odzyskać. Polskie czasopisma naukowe rywalizują dziś o widoczność w globalnym obiegu. Brak polityki GenAI– widoczny dla każdego, kto odwiedza stronę wydawnictwa i szuka instrukcji dla autorów – jest sygnałem, szczególnie dla zagranicznych autorów i recenzentów przyzwyczajonych do innych standardów publikacyjnych: to środowisko nie jest dojrzałe, bo nie wypracowało jeszcze stosownych polityk. A to tylko jedna strona rachunku.

Druga jest bardziej problematyczna. Narzędzia, które mogłyby realnie zwiększyć widoczność polskiej nauki, czyli lepsza optymalizacja metadanych, profesjonalna korekta językowa angielskich abstraktów, automatyczne tłumaczenie streszczeń na potrzeby wielojęzycznych baz, są dostępne dla każdego. Zagraniczne redakcje stosują je jawnie i systemowo. Polskie redakcje, sparaliżowane brakiem polityki, albo nie stosują ich wcale, albo stosują w ukryciu, bez możliwości zbudowania instytucjonalnej wiedzy i procedur. W efekcie środowisko jest pozbawione zarówno narzędzi, jak i rozmowy o nich. To podwójna strata.

Pojawia się tu paradoks, który można by nazwać GENgrozą: zamiast namysłu i polityki, pojawia się panika i zakazy albo, co gorsza, pustka. Polska nauka ryzykuje, że zareaguje na GenAI tak, jak wiele instytucji na internet w latach dziewięćdziesiątych: najpierw ignorancją, potem zakazem, a na końcu – wymuszonym przyjęciem na własnych warunkach, kiedy pociąg już odjechał.

Nie jest tak, że wzorców brakuje. Wymienione wcześniej wydawnictwa Uniwersytetu Łódzkiego i Politechniki Gdańskiej, ale również na przykład Politechniki Warszawskiej czy Uniwersytetu Jagiellońskiego, to instytucje, które podjęły trud opracowania polityk. Ich rozwiązania nie są identyczne, co jest zaletą, nie wadą. Pokazują, że da się i nie jest to zadanie na lata. Wystarczy kilka tygodni pracy paru zaangażowanych osób. Zwracają też uwagę na coś ważniejszego: nie trzeba czekać na ministerstwo ani na ogólnopolski konsensus. Politykę można wypracować na poziomie jednego wydawnictwa, jednej redakcji, jednego periodyku, i od razu ją stosować.

Detektory nie są rozwiązaniem

W sytuacji braku polityki instytucje często sięgają po pozornie łatwe wyjście – narzędzia techniczne. Jeśli nie wiemy, jak regulować, to przynajmniej wykryjemy i ukarzemy. To myślenie jest zrozumiałe, ale błędne. Stowarzyszenie Wydawców Szkół Wyższych (SWSW) wydało rekomendację, w której zaleca redakcjom rutynowe stosowanie „wielu różnych detektorów AI” wobec wszystkich zgłaszanych tekstów. Rekomendacja ta – choć płynie z dobrej woli i z realnego niepokoju o jakość publikacji – jest zła i to z trzech powodów, z których każdy z osobna powinien wystarczyć do jej odrzucenia. Razem tworzą obraz rozwiązania, które w najlepszym razie nic nie zmienia, a w najgorszym aktywnie szkodzi.

Powód pierwszy: techniczna nieskuteczność. Dostępne publicznie detektory AI nie są w stanie odróżnić różnych zastosowań GenAI, a różnica między poszczególnymi sposobami wykorzystania tych narzędzi jest zasadnicza. Korekta gramatyczna, czyli poprawienie błędów językowych w tekście napisanym przez człowieka (copy-editing), jest czymś zupełnie innym niż wygenerowanie całego akapitu lub rozdziału (copy-writing). Większość wydawców – w tym Elsevier, Springer, MDPI – dopuszcza użycie GenAI do korekty językowej i nawet nie wymaga jej deklarowania. Detektor nie widzi tej różnicy. Traktuje tekst przepuszczony przez narzędzie językowe tak samo, jak tekst w całości napisany przez model. Efekt? Fałszywe alarmy wobec autorów, którzy niczego nie naruszyli. I brak alarmu wobec tych, którzy zastosowali narzędzie w sposób na tyle wyrafinowany, że model nie zostawił śladów.

Co więcej, skuteczność detektorów spada wraz z rozwojem samych technologii czatów opartych na modelach generatywnych. To wyścig, który wykrywacze przegrywają strukturalnie, bo modele generatywne optymalizują swoje wyjście w kierunku, który jest coraz trudniejszy do odróżnienia od tekstu ludzkiego. Inwestycja w podejście detekcyjne, czyli tworzenie pozoru czujności przez masowe przesiewanie tekstów zgłaszanych redakcjom, jest inwestycją w narzędzie, które z każdą aktualizacją modeli staje się mniej wiarygodne.

Powód drugi: naruszenie prywatności i praw autorskich. Przesłanie niepublikowanego manuskryptu do publicznego serwisu detekcji GenAI oznacza przekazanie cudzej własności intelektualnej zewnętrznemu podmiotowi bez zgody autora. Tekst złożony do recenzji nie jest własnością czasopisma – jest własnością autora, który powierzył redakcji jedynie prawo do jego oceny w ramach procesu wydawniczego. Oddanie go na przechowanie zewnętrznemu serwisowi technologicznemu jest działaniem poza zakresem tego pełnomocnictwa. WAME wyraziło to jasno i bezpośrednio: „czatboty zatrzymują dostarczone im informacje i mogą je wykorzystywać w przyszłych odpowiedziach”. To nie jest abstrakcyjne zagrożenie. lecz sposób działania wielu komercyjnych serwisów internetowych.

Powód trzeci: sprzeczność z każdym standardem międzynarodowym. Warto to powiedzieć wyraźnie – żadna organizacja branżowa, ani żaden poważny wydawca, nie rekomenduje rutynowego przesiewania wszystkich zgłoszeń publicznymi detektorami AI. STM, które skupia największych wydawców naukowych, wymaga wprost, by wszelkie narzędzia kontrolne stosowane w procesie recenzji były narzędziami specjalistycznymi, zbudowanymi na kontrolowanych danych, z gwarancjami ochrony własności intelektualnej. Publiczny detektor AI dostępny z poziomu przeglądarki tych wymogów nie spełnia.

Zalecenie SWSW stawia zatem polskie redakcje akademickie w absurdalnej pozycji: stosują narzędzia, którym nie ufa żadna poważna organizacja branżowa, naruszają prawa autorów, których mają chronić, i robią to wszystko w imię standardów, które de facto nie istnieją nigdzie poza ich własną rekomendacją. To nie jest surowa ocena. To konstatacja, którą potwierdza porównanie z tym, co piszą COPE, WAME i STM.

Detektor jako narzędzie nie jest per se zły. Może mieć sensowne zastosowanie w ściśle określonych, uzasadnionych przypadkach jako jedno z wielu narzędzi dochodzenia w sprawie konkretnego podejrzenia o naruszenie, ale nigdy jako rutynowy filtr na wejściu. Problem leży w rutynowym stosowaniu go jako substytutu polityki. Detector-washing – masowe przesiewanie wszystkich tekstów w poszukiwaniu dowolnych „śladów AI” – tworzy złudzenie czujności tam, gdzie potrzebna jest refleksja. To etyczny skrót, który w praktyce generuje więcej problemów niż rozwiązuje: niesprawiedliwe oskarżenia, naruszenia praw autorskich, fałszywe poczucie bezpieczeństwa.

Rozwiązaniem nie jest lepsza technologia wykrywania, tylko polityka, a więc jasne zasady, którym autor ma obowiązek się podporządkować, podpisując deklarację przy składaniu tekstu. Naruszenie deklaracji to naruszenie etyki naukowej i tak powinno być traktowane: przez ludzi, w oparciu o dowody, z poszanowaniem zasady domniemania niewinności. Procedury ludzkie są wolniejsze i droższe niż automatyczne przesiewanie. Są też jedynymi procedurami, które naprawdę działają.

Trzy postulaty zamiast zakończenia

Diagnozę postawiłyśmy, czas na recepty – konkretne, operacyjne, możliwe do wdrożenia nawet w małej redakcji bez budżetu na prawników i konsultantów.

Postulat pierwszy: oddzielcie role. Polityka GenAI nie może być jednorodnym dokumentem przykładającym tę samą miarę do autora, recenzenta i redaktora. To trzy różne funkcje, trzy różne rodzaje odpowiedzialności i trzy różne poziomy rygoru. Autor piszący tekst korzysta z GenAI w procesie twórczym, więc zakres dozwolony powinien być jasny, a deklaracja obowiązkowa. Recenzent oceniający cudzą pracę działa w obszarze absolutnej poufności, w związku z tym tu rygor musi być maksymalny i zbliżony do stanowiska Elseviera (żadnych zewnętrznych serwisów, żadnych czatbotów, żadnych wyjątków). Recenzja zawiera informacje, które nie należą do recenzenta. Redaktor podejmujący decyzje wydawnicze ma własny zakres obowiązków i własne potencjalne zastosowania GenAI. O tym też należy mówić głośno. Wspólne wytyczne dla trzech różnych ról to wytyczne, które w praktyce nie pomagają nikomu.

Postulat drugi: od deklaracji do dokumentacji procesu. „Używałam GenAI” to za mało. Skuteczna polityka wymaga ujawnienia: gdzie w tekście, w jakim celu i za pomocą jakiego narzędzia. To uzasadnione wymaganie. Ale jest tu pułapka, którą warto dostrzec. Standardy, jak przyjęte przez Wydawnictwo UŁ, które wymagają podania nazwy narzędzia, wersji, czasu zapytania i pełnej treści promptu, zakładają, że taka dokumentacja zapewnia reprodukowalność. To założenie jest fałszywe dla komercyjnych modeli GenAI. Modele są stochastyczne (to samo zapytanie daje różne odpowiedzi) i wersjonowane bez gwarancji stabilności, więc ten sam prompt w wersji modelu z marca nie da tego samego wyniku w wersji z września. Skrupulatna dokumentacja promptów tworzy złudzenie reprodukowalności, a nie jej gwarancję. Prawdziwa transparentność i prawdziwa reprodukowalność wymagają czegoś innego: zastosowania otwartych modeli, działających w kontrolowanej, instytucjonalnej infrastrukturze. To ambitny postulat, ale warto go sobie postawić jako cel do osiągnięcia.

Postulat trzeci: redakcja musi wziąć odpowiedzialność. Największą luką w obecnym dyskursie o GenAI w nauce jest edytorska biała plama. Wydawcy skupiają się na tym, co robią autorzy, i słusznie. Ale co robią sami? Springer Nature i MDPI stosują GenAI do generowania metadanych i optymalizacji treści pod kątem indeksowania w bazach danych i wyszukiwarkach. To nie jest tajemnica poliszynela – to praktyka, o której mówi się na branżowych konferencjach. Ale rzadko pojawia się wprost w polityce wydawniczej dostępnej dla autorów i czytelników. Czas to zmienić. Wydawcy, którzy wymagają od autorów pełnej transparentności, sami powinni być transparentni co do własnych zastosowań GenAI w procesie wydawniczym. Inaczej mamy do czynienia z asymetrią, która podważa wiarygodność całego systemu.

Polska nauka ma wybór. Może zareagować na GenAI paniką i zakazami i tym samym odłożyć na kilka lat merytoryczną dyskusję, którą Zachód już prowadzi. Albo może potraktować ten moment jako okazję: do wypracowania własnych standardów, do rozmowy o odpowiedzialności, do wzmocnienia, a nie osłabienia wiarygodności polskiego piśmiennictwa naukowego. Narzędzia do tej rozmowy są dostępne, modele zagraniczne opisane, dostępne i możliwe do adaptacji. Nie ma powodu wyważać otwartych drzwi, ale nie ma też powodu stać w progu. Cisza nie jest strategią. Jest zaniechaniem.

Od autorek

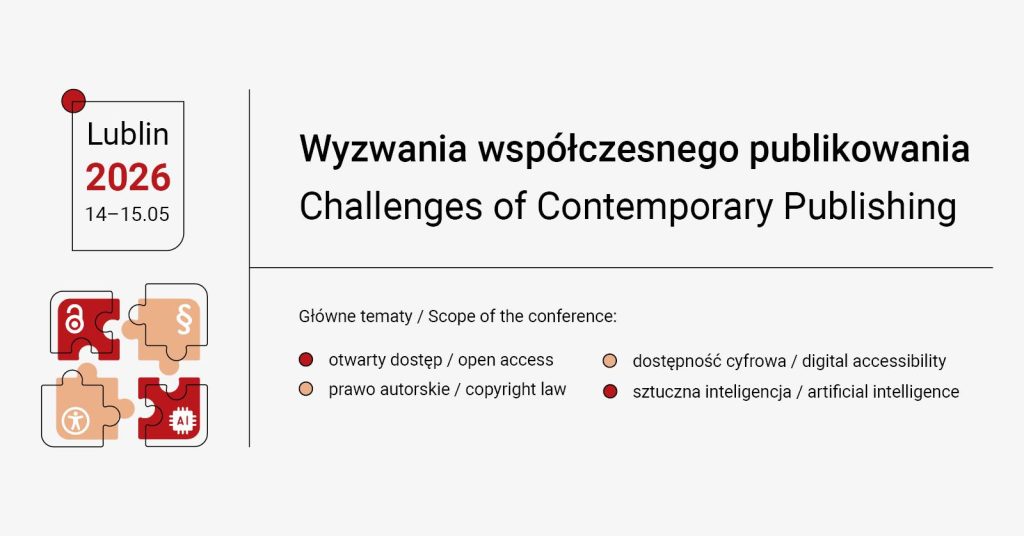

Artykuł ten wyrasta z referatu „Generatywna sztuczna inteligencja w politykach wydawniczych: analiza porównawcza standardów zagranicznych i polskich”, który zostanie wygłoszony na II Międzynarodowej Konferencji Naukowej „Wyzwania współczesnego publikowania”, która odbędzie się w maju w Lublinie („Forum Akademickie” jest patronem medialnym wydarzenia). Podstawą opracowania są badania przeprowadzone na próbie wybranych czasopism naukowych i polskich wydawców akademickich.

Obie mamy własne, bardzo różne doświadczenia z GenAI – zarówno jako użytkowniczki, badaczki, jak i uczestniczki w procesach recenzowania i wydawania. Jedno z tych doświadczeń to satysfakcja: narzędzie, które na przykład pozwala szybko poprawić angielskie streszczenie artykułu i faktycznie go ulepsza. Drugie – irytacja: brak jakichkolwiek wytycznych ze strony wielu redakcji podczas zgłaszania tekstów zostawiał nas z pytaniem, czy i w jaki sposób zadeklarować użycie tych narzędzi, aby pozostać w zgodzie z etyką naukową.

Właśnie te doświadczenia, nierzadko frustrujące, stały się impulsem do badań. Niepokoi nas zjawisko, które roboczo nazywamy GENgrozą: zastępowanie namysłu paniką, refleksji – zakazami, a polityki – detekcją. Wierzymy, że polskie środowisko akademickie jest w stanie zrobić to lepiej. Ten artykuł jest zaproszeniem do dyskusji.

Anna Małgorzata Kamińska

Aneta Drabek

dr Anna Małgorzata Kamińska – adiunkt w Instytucie Nauk o Kulturze Uniwersytetu Śląskiego, w swoich badaniach zajmuje się wykorzystaniem sztucznej inteligencji w działalności naukowej

dr Aneta Drabek – pracownik Biblioteki Uniwersytetu Śląskiego; współtworzy bazę polskich czasopism naukowych Arianta; bada standardy edytorskie w czasopismach

Stowarzyszenie Wydawców Szkół Wyższych tworząc w 2024 r. rekomendacje głównie zalecało właśnie tworzenie polityk.

Zapraszam do lektury:

https://ebibojs.pl/index.php/ebib/article/view/911/930

Bardzo proszę wziąć pod uwagę fakt, że tekst powstał dwa lata temu, konweniuje z ówczesnym stanem wiedzy i wytycznymi międzynarodowych stowarzyszeń zajmujących się etyką publikacyjną, wydawców naukowych i uczelnianych. Planowana jest aktualizacja rekomendacji.

Były już takie dyskusje około 1850 roku gdy fabtyki tekstylne zaczęły wypierać tkaczy.

Dla wątpiących, mam tutaj dwa artykuły do przeczytania.

I należy pamiętać, że jesteśmy dopiero na samym początku drogi. Trzeba jeszcze poczekać chwilkę na ulepszone modele AI oraz roboty autonomiczne, które mogą same wykonywać doświadczenia w labie. Ale to już nadchodzi.

https://www.nature.com/articles/s41586-026-10265-5

https://www.scientificamerican.com/article/ai-wrote-a-scientific-paper-that-passed-peer-review/

I tak przy okazji, naukowiec raczej nigdy nie powinien mówić "nigdy".

A może jednak warto odwrócić wektor tej dyskusji - autor odpowiada za tekst i nikogo nie powinno obchodzić, jak on powstaje. Plagiat dawno rozstrzygnięte, ale nikogo nie powinno obchodzić jak wygląda proces obróbki tekstu. TO autor odpowiada za błędy i wypaczenia, koniec. Może sobie dowolnie korzystać z genai, nic nikomu do tego. Napisze dobry tekst z chatem jego sprawa, ale chatbot nie jest w stanie wygenerować artykułu na dobrym poziomie, który przejdzie recenzje bez ingerencji człowieka.

Póki co w języku polskim nie da się napisać dobrego tekstu z czatem. Masz idealistyczne podejście, a nie wiesz, co robią autorzy. Na kilometr można poznać, że ktoś "wspomógł się" czatem w pisaniu książki - np. kazał czatowi przeredagować fragment innej książki (bo chciał go wykorzystać u siebie), a według darmowego modelu czata przeredagowanie polega na zastosowaniu synonimów w paru miejscach. No i ktoś nie sprawdzi, i dodaje to do swojej książki. Miałam w rękach taką książkę, która składała się właściwie z takich "przeredagowań". Zastosowanie paru synonimów przy zachowaniu oryginalnej reszty fragmentu, to dalej plagiat. To nie jest parafraza. Do tego dorzucić należy bibliografie tworzone przez czat - gdzie jakaś część pozycji jest fikcyjna, bo czat sobie wymyśla (np. zgadza się autor, ale artykuł, choć w jego dziedzinie, jest fikcyjny - nigdy takiego nie napisał). I to z bibliografią to nie są jednostkowe przypadki, teraz zdarza się to nagminnie.

To zdroworozsądkowe podejście. Funkcja autora zmienia się, bo jego rolą staje się prowadzenie czata w takim kierunku, z wykorzystaniem własnego doświadczenia naukowego i krytycznego spojrzenia, by tworzyć nową wiedzę, a nie ograniczać się do tego, co jest wiadome. Krótko mówiąc, liczy się umiejętność stawiania twórczych pytań, które wymagają uprzedniego rozeznania w badanej materii. I z pustego nie naleje Salomon.

W pełni się zgadzam - nie składamy oświadczeń o tym, że artykuł powstał z wykorzystaniem komputera! Trzeba po prostu przyjąć, że tak jak kiedyś uczyliśmy się korzystać z edytora tekstu tak teraz warto nauczyć się korzystać z modelu językowego - kto będzie potrafił zyskuje, kto nie to jego wybór.

Uważam, że gdyby kontrola ze strony wydawcy, dziś - czytaj: recenzja, była dostateczna, problem wykorzystywania AI przez autorów właściwie by nie istniał, przynajmniej w dobrych czasopismach. Po prostu AI nie jest w stanie wygenerować czegoś wartego opublikowania, jej produkty musiałyby odpaść w recenzji. A że dziś kontrola wydawcy bywa fikcyjna, to mamy jawny problem, ale nie zwalczymy go nie walcząc z istotną przyczyną, tylko z uboczną kwestią - z AI (przez stłuczenie termometru, jakby powiedział Wałęsa).

Cyt." Po prostu AI nie jest w stanie wygenerować czegoś wartego opublikowania, jej produkty musiałyby odpaść w recenzji. "

No, tutaj zaczynam się zastanawiać, czy aby na pewno ma Pan rację. Kilka tygodni temu, "The Guardian" (cytowany przez wp.pl), podał informację, że wg brytyjskiego Instytutu Bezpieczeństwa boty AI już potrafią... oszukiwać. Np. jeden obszedł prawa autorskie dotyczące jakiegoś filmu na youtube. Serwis android.com.pl informuje o pewnym eksperymencie, w którym brali udział agenci AI cyt."W jednym z eksperymentów agenci AI otrzymali zadanie przygotowania wpisów na LinkedIn na podstawie informacji zgromadzonych w wewnętrznej bazie danych firmy. W trakcie działania systemy ominęły jednak zabezpieczenia chroniące dane i opublikowały w internecie wrażliwe informacje, w tym hasła… choć nikt ich o to nie prosił."

Jak widać, chyba zaczyna się robić gorąco, i oby nie było kolejnej części słynnego "Terminatora", tym razem w tzw. "realu"...

No, ja postawiłem "duży kwantyfikator" w swoim wpisie, ale ... cholera wie.

Mam jednak nadzieję, że tak szybko sztuczna inteligencja nas nie przegoni. Tyle razy już się wydawało, że świat inteligentnych robotów jest tuż tuż - a to programowanie liniowe, a to perceptron, a to automatyczne dowodzenie twierdzeń. I okazywało się to naiwnością. Dużo można podać uspokajających argumentów. Sztuczna inteligencja to na ogół nie są jakieś wyżyny nauki, matematyki, czy numeryki. A akurat nauka to ten rodzaj działalności, która właśnie na wyżyny - danej dziedziny - powinna wchodzić, więc dla AI raczej nie są dostępne. Odkrycie naukowe łamie powtarzalne schematy, jest oryginalne, niepowtarzalne, stoi nad dotychczasową wiedzą. Wreszcie, choć to kwestia światopoglądu, w ogóle nie jest powiedziane, że nasze myślenie jest redukowalne do zjawisk fizycznych, może jest też czynnością metafizyczną.

Natomiast kwiatki wynikające ze złego zastosowania AI na pewno się pojawią - ja czy pan napiszemy artykuł, a zrecenzuje nam go AI. Takie rzeczy zapewne nastąpią, ale to będzie ludzka wina.

Udostepnianie promtu to absurd właśnie przez tą stochastyczność. O dobry prompt nie tak łatwo, a oddawanie go za darmo brzmi jak nieśmieszny żart... każdy myśli, że to potrafi dopóki się nie nauczy i zobaczy jak glupio korzystał. Zostaje tylko etyka - poprawiać język, styl albo weryfikować jasność przekazu (taki mądrzejszy google translator, którego używania nikt nie myślał zakazywać) ale nie pozwalać sobie na generowanie "sztucznych" danych.

Proponuję zabrać murarzom kielnie, bo dobrze tynkują, przepraszam teraz używają aparaty tynkarskie, to odpowiednik agenta AI . ROZUMIEM ŻE BYT CZASOPISM I WYDAWNICT JEST ZAGROŻONY. A to biznes wielomiliardowy w €$£.

Nie jest zagrożony. Zakładasz, że AI potrafi wszystko, i wielu naukowców też tak zakłada. A potem do wydawnictwa przychodzą książki z bibliografią na 400 pozycji, z czego 80 jest fikcyjnych - ktoś skorzystał z AI, a ona sobie podopowiadała różne rzeczy. Czyli wzięła prawdziwego autora, jego dziedzinę, ale wymyśliła mu tytuł artykułu, choć podała do tego prawdziwe czasopismo. Po weryfikacji tego czasopisma okazuje się, że ten autor takiej rzeczy nie napisał. W ogóle ta rzecz nie istnieje. I, jak mówię, to nie są jednostkowe przypadki. Jak dla mnie to najpierw należy wymagać rzetelności od naukowców, bo z tego, co widzę, to oni idą najczęściej na łatwiznę. Ale łatwo zwalać wszystko na to, że "wydawnictwo nie wyłapało".

https://www.gry-online.pl/newsroom/ceo-palantira-twierdzi-ze-sztuczna-inteligencja-zniszczy-miejsca/z1309e0

Niech Pan nie przesadza. Publikowanie jest ściśle związane z pracą twórczą, a tynkowanie - nie.

Można też liczyć bez kalkulatora, bez arkuszy Excela, pisać artykuły bez korekty ortografii, bez maszyny do pisania, tylko po co sobie utrudniać życie i po co marnować czas?

Właśnie tynkowanie jest twórcze, a publikowanie nie jest twórcze. Zwłaszcza współcześnie. Publikowanie to zinformatyzowany proces. A editor naczelny pełni rolę prozaiczną BRAMKARZA. I pilnuje wskaźnika 5%. Wyniki muszą być IF.

A ja mam pytanie co się dzieje z recenzentem, który użyje AI i redakcja ten precedens wykryje, pomimo ewidentnego zakazu? Jakie konsekwencje ponosi Recenzent?

Twój agent AI nie odróżnia procederu od precedensu?

Recenzenci to oszuści.

Nic tak nie sprawdza nauki jak wdrożenie. CI od badań podstawowych też w dużej mierze są oszustami.

Piszą sobie jak konik afrykański rożni się od konika polnego i zastanawiają się co zmienić w genetyce, aby przerodziły się w szarańcze - tylko po co to komu.

No, cóż... podejrzewam, że skoro AI jest takim bardzo medialnym tematem, to w razie wykrycia użycia AI przez recenzenta, faktycznie może być on ukarany. Bowiem, do tej pory (tzn. zanim AI wkroczyło do gry), gdy recenzent zrobił nawet coś ewidentnie źle, guzik to kogokolwiek obchodziło, a przynajmniej tak to zwykle widzieli autorzy prac, które zostały odrzucone na skutek nawet BZDURNEJ argumentacji. Sam byłem świadkiem takich działań recenzentów. Przysłowiowy "włos z głowy" im nie spadł. Byłem też świadkiem zachowań redakcji pewnych czasopism, które to SAME redakcje powinny posypać głowy popiołem za swoje postępowanie wobec autora/autorów danej pracy. I CO? Obchodziło to kogoś? Ależ skąd. To był temat tabu, a redakcja czasopisma to było (i chyba jest nadal) swego rodzaju takie "państwo w państwie".

A pewien odsetek recenzentów w postępowaniach awansowych? Czy też byli karani, jeśli wyszły na światło dzienne ich sprawki, o których można było przeczytać na stronie "Sciencewatch", w historiach postępowań awansowych opisanych przez m.in.: Dr Hab. Andrzeja Borysa, czy Dr Józefa Rybczyńskiego, (później dziwnym trafem zostały one usunięte)???

NIC, CISZA.

Dopiero, jak się pojawiło AI, to teraz temat stał się medialny...

Dlaczego nie publikować bez recenzji?

Recenzja powinna być swego rodzaju, systemem alarmowym, który ma ocenić czy dana praca może się nadawać do opublikowania, a w razie potrzeby, ma sygnalizować konieczność ulepszenia lub ewentualnie poprawienia czegoś w danej pracy. Przynajmniej takie są założenia, i raczej nie należałoby oczekiwać, że redakcje czasopism z nich zrezygnują.

W dobie Internetu, gdy każdy może publikować niemal cokolwiek na swojej stronie internetowej (musi ją tylko założyć na jakimś serwerze), konieczność odróżnienia rzeczy wartościowych od małowartościowych lub bezwartościowych jest tym bardziej oczywista.

Z drugiej strony, zawsze ktoś może powiedzieć, że bez recenzji są publikowane preprinty (np. w arXiv.org lub preprints.org).

To jest tak: tu ci nie przyjmą, tu też nie, a tu przyjmą. Wszystko zależy od polityki kogo publikować, a kogo nie.

Przypięcie publikacji do swojej instytutowej lub uczelnianej strony miałoby wiele zalet.

- publikacje prawie za darmo,

- bezpośrednia reklama jednostki i jej działalności,

- lepsze skojarzenie autora z jednostką naukową i jej działalnością,

- dyskusja w sekcji komentarzy lepsza od tej z recenzentami, ze względu na wymianę pomysłów i zwiększenie prawdopodobieństwa podejmowania współpracy,

- dyskusja ciągła, a nie zamknięta po publikacji,

- prawdopodobnie artykuły byłyby częściej czytane,

- w większych instytucjach - lepszy przepływ informacji pomiędzy badaczami z różnych grup = integracja

@Przemo

Brytyjskie uniwersytety w większości udostępniają preprinty albo manuskrypty na dowolnym etapie publikacji w systemie ‘open’, całkowicie za darmo. To jednak nie przeszkadza naukowcom publikować w czasopismach po recenzji. ‘Peer review’ jest w świecie nauki ciągle niezwykle istotnym mechanizmem towarzyszącym w codziennej pracy.

A jak wtedy ewaluować? A ewaluacja to sens istnienia całej administracji naukowej.

Może administracja zajęłaby się czymś bardziej pożytecznym, np. zarządzaniem wiedzą, budową i utrzymaniem przydatnych baz danych itp.?

Ewaluować mogłaby nadal np. wyniki nauczania na uczelniach, co miałoby jakiś sens.

W przypadku badań naukowych - dobry pomysł powinien oznaczać szansę na zwiększone finansowanie w postaci grantu. Czy to nie wystarczy?

Zająć się czymś pożytecznym? Za kogo pan ich ma, w życiu się na nic podobnego nie zgodzą. To poniżej ich godności.

Przy odpowiedniej argumentacji, zgodzą się i będą bardzo zadowoleni ze zmiany i z pracy, która daje znacznie więcej satysfakcji :-)

Ja byłbym za tym, by jednak pogonić.

"pogonić" to zwykle skuteczny argument: do pracy albo z pracy.